OpenAI迎来大考!超级智能对齐团队解散后,谁来保证GPT-4o工作的安全

OpenAI的“宫斗”大戏刚落下帷幕,转眼间又上演了离职潮和团队解散的戏码。

近日,据爆料称,OpenAI的长期人工智能风险团队据悉已经解散。OpenAI安全主管、“超级智能对齐团队”负责人Jan Leike在社交平台宣布离开OpenAI,而他们共同领导的“超级智能对齐团队(AI风险团队)”也被证实解散。

不过话说回来,这“超级对齐”团队的解散,可真是让人大跌眼镜啊!想当初OpenAI可是信誓旦旦地表示要投入20%的算力来搞这个团队,结果呢?一年不到就解散了,真是让人哭笑不得。

更让人担心的是,这解散安全团队的行为,无疑会让OpenAI在人工智能领域的安全性和可信度大打折扣。毕竟,安全是人工智能发展的前提和基础,没有安全就没有一切。OpenAI这么做,岂不是在自毁前程?

同时,一份有关“封口协议”的爆料,又让这件事显得更加扑朔迷离。一位名为Kelsey Piper的OpenAI前员工爆料称,公司任何员工的入职文件说明中都有这样一项要求,即“在离开公司的60天内,员工必须签署一份包含‘一般豁免’的离职文件。如果没有在60天内完成签署,员工的股权收益就会被取消”。也就是说,OpenAI以股权为条件,制定了令员工认为不合理的离职条款。

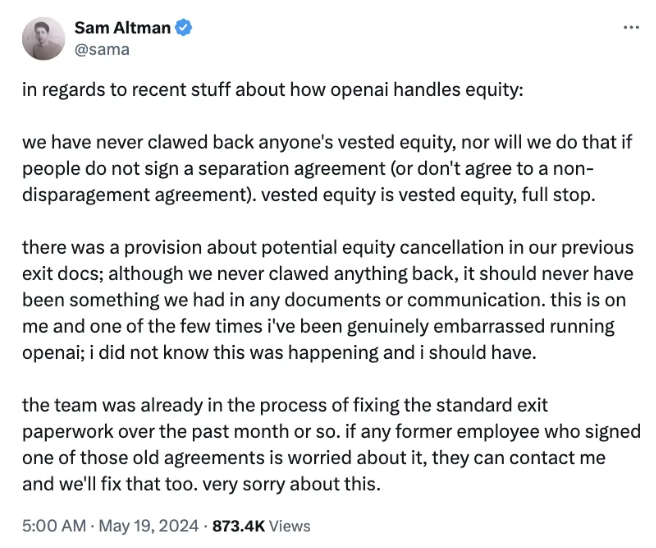

这次就连奥特曼也不淡定了,直接发出两篇“小作文”进行澄清,一篇短的,回应了离职霸王条款,也就是员工离职后说OpenAI坏话会被收回股权的事儿,称“我们从未收回过任何人的既得股权,如果有人不签署离职协议,我们也不会这样做,既得股权就是既得股权”。

另一篇超长,讲了OpenAI的整体安全战略,回应了OpenAI前超级对齐负责人Jan Leike昨天的13条推文爆料:核心意思大概就是OpenAI对AGI的安全治理,优先级不如推出“闪亮的产品”。有网友分析:OpenAI的策略是通过测试、不断的反馈来改进模型确保AI安全性,这其实和超级对齐团队主张的预先给出证明的方法相悖,也难怪他们会分道扬镳。

但让人深思的是,随着安全团队被掏空,谁来确保OpenAI的工作是安全的?

川公网安备 123456789号

川公网安备 123456789号