Stable Diffusion WebUI的界面布局

今天,我们将一同来探索Stable Diffusion WebUI的界面,了解其布局及各项功能。

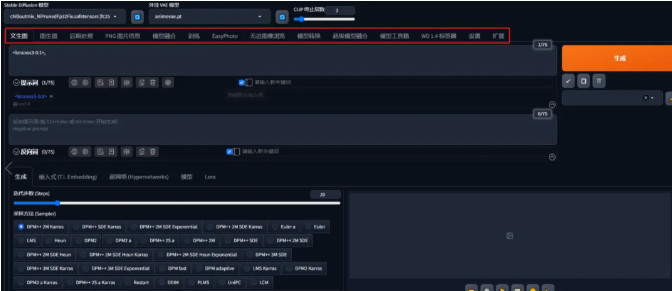

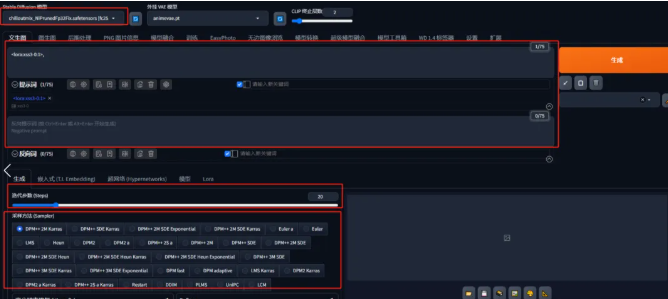

首先,我们来看Stable Diffusion WebUI的界面布局。这个界面大致分为三大区域:模型选择区、功能选择区以及参数配置区。

在模型选择区,我们可以找到各种类型的模型,包括写实类、2.5D类、二次元类等。这些模型可以根据个人需求进行下载。值得注意的是,秋叶大佬的整合包中默认包含了一个二次元模型,非常方便。当然,想要找到更多合适的模型,可以访问civitai网站,不过可能需要一些科学的上网技巧。另外,国内的朋友也可以尝试使用liblib网站进行模型搜索和下载。在下载时,要注意区分CHECKPOINT和LORA,前者是基础模型,后者则是在基础模型上进行了微调的模型。

此外,VAE模型(Variational Auto-Encoder)也是一个重要的部分。通常,我们可以选择自动模式。但需要注意的是,SD1.*模型和SDXL模型的VAE是不同的,需要下载时进行区分。VAE的主要作用是压缩图片到一个更小的空间维度,减少图片中的冗余信息,使图片能够映射到一个较小的隐式表征,并从这个表征中恢复出原始图片。关于这部分的原理,我们将在后续的文章中进行详细介绍。

接下来是功能选择区。这里提供了多种功能,包括文生图(根据文本提示生成图像)、图生图(通过图像生成新的图像)、后期处理(对生成的图片进行进一步处理)等。此外,还有PNG信息功能,可以快速获取图片生成参数,方便我们进行参数复制和分享。模型融合功能则允许我们最多组合3个模型来创建新的模型,用于混合不同模型的风格。不过,需要注意的是,模型融合的结果并不总是理想的,有时可能会产生一些不需要的伪影。此外,训练页面也提供了训练模型的功能,支持textual inversion(embedding) 和hypernetwork等多种训练方式。

最后,我们来看看参数配置区。这里包括了选择模型、正反提示词、采样方式、迭代步数、生成图片尺寸、批次和数量以及CFG比例等参数设置。这些参数的设置将直接影响到生成图片的效果和速度。例如,正反提示词用于描述我们希望在图像中看到的内容,正向提示词指定我们想看到的内容,而反向提示词则用于排除我们不希望看到的内容。采样方式则决定了去噪过程中的算法,不同的采样方式会产生不同的生成效果和速度。迭代步数则决定了去噪过程中的采样步骤数,步数越多,生成的图片质量通常越高,但所需时间也会越长。

总的来说,Stable Diffusion WebUI的界面设计非常直观,功能丰富且强大。通过合理的参数配置和功能选择,我们可以轻松生成出满足自己需求的图像。当然,想要更深入地了解和使用这个工具,还需要我们在后续的学习和实践中不断探索和积累。

川公网安备 123456789号

川公网安备 123456789号