微软发布Phi-3系列AI模型,挑战OpenAI领导地位

近日,科技巨头微软在人工智能领域又掀起了一股新浪潮,其推出的Phi-3系列小型AI模型引发了业界的广泛瞩目。这款模型不仅展示了令人惊艳的性能,更因其出色的表现,直接挑战了OpenAI在业界的领导地位。

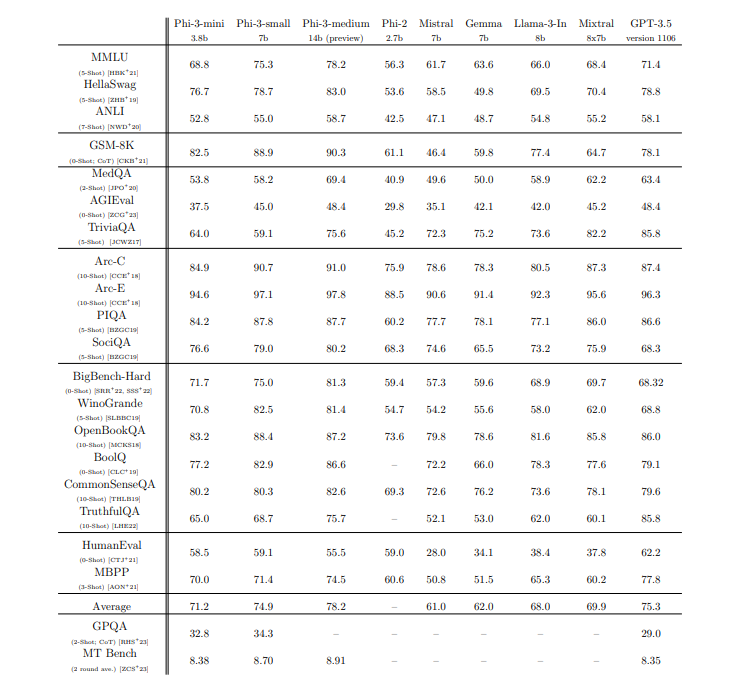

据悉,Phi-3系列中的Phi-3-mini模型尽管仅拥有3.8B参数,但在多项基准测试中却展现出了超乎想象的实力,成功超越了8B参数的Llama3模型。这一骄人成绩的取得,得益于微软在AI模型训练技术上的深度挖掘与创新。

更值得一提的是,经过4bit量化处理的Phi-3-mini模型,竟然能够在iPhone14Pro和iPhone15所使用的苹果A16芯片上实现每秒12token的运行速度。这一突破意味着,手机用户将能够在自己的设备上享受到接近ChatGPT水平的智能对话服务,这无疑为移动AI应用的发展开辟了新的道路。

微软在其技术报告中详细阐述了Phi-3系列的众多优势。除了Phi-3-mini之外,该系列还包括Phi-3-small和Phi-3-medium两个版本,分别具备7B和14B参数。这些模型不仅在性能上有所提升,更在功能和应用场景上进行了全面拓展。例如,Phi-3-small通过采用独特的分词器和增加多语种数据,使其能够更好地适应不同语言环境下的使用需求;而Phi-3-medium则在更多数据上进行了训练,已在多数测试中超越了GPT-3.5和Mixtral8x7b MoE等业界标杆模型。

那么,Phi-3系列是如何实现这一系列突破的呢?业内专家普遍认为,这主要归功于微软团队在模型训练方法上的独到之处。他们发现,单纯地增加模型参数量并不是提升性能的唯一途径。相反,通过精心挑选和设计训练数据,特别是利用大型语言模型生成的高质量合成数据,结合严格筛选的真实数据,可以显著提升中小模型的性能。这种以数据为驱动的训练方法,不仅增强了模型的泛化能力,也使其在实际应用中表现得更加稳定和可靠。

然而,值得注意的是,尽管Phi-3系列在性能上取得了显著突破,但小型模型在存储事实和知识方面仍存在一定的局限性。这一点在Phi-3系列在TriviaQA测试中的表现中得到了体现。对此,微软提出了通过联网接入搜索引擎来弥补这一缺陷的方案。这一创新思路不仅有助于提升模型的知识储备能力,也为其在未来的应用中提供了更多可能性。

微软研究院团队表示,他们将继续沿着小模型和数据工程的道路深入探索,并计划进一步增强小模型的多语言能力和安全性。这一发展方向不仅符合当前AI技术的发展趋势,也符合市场对更加智能、便捷和安全的AI服务的需求。

随着Phi-3系列的发布,微软在AI领域的实力再次得到了有力证明。同时,这一举措也在开源社区中引发了广泛讨论。许多业内人士认为,Phi-3系列的成功将对OpenAI构成强大压力,促使其加快推出GPT-3.5的后继产品以维持其市场地位。这无疑将进一步推动AI技术的竞争与发展,为整个行业带来更多的创新与突破。

展望未来,随着技术的不断进步和应用场景的不断拓展,AI模型将在更多领域发挥重要作用。我们期待看到更多像Phi-3系列这样的优秀模型涌现出来,为人类社会的发展带来更多便利与惊喜。

川公网安备 123456789号

川公网安备 123456789号