中国AI被偷家,斯坦福涉嫌抄袭!网友调侃:竟有美国套壳中国的一天

过去一年,中国大模型一直被贴上「追赶美国」的标签,但近日,推特上却有人曝出:美国斯坦福大学的一个 AI 团队疑似抄袭、「套壳」一家中国大模型公司的开源成果,模型架构与代码完全相同。

5 月 29 日,一个来自斯坦福的作者团队在 Medium 上发布了一篇名为《Llama 3-V: Matching GPT4-V with a 100x smaller model and 500 dollars》的文章,文章中称他们训练出了一个比 GPT-4V、Gemini Ultra、Claude Opus 更强的 SOTA 开源多模态模型,尺寸比 GPT4-V 小 100 倍,训练成本仅需 500 美元。

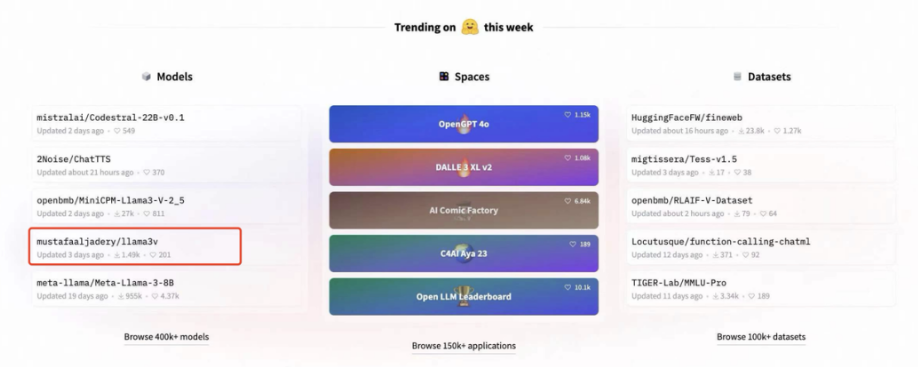

由于该团队的作者(Mustafa Aljaddery、Aksh Garg、Siddharth Sharma)来自斯坦福,又集齐了特斯拉、SpaceX、亚马逊与牛津大学等机构的相关背景经历,很快该模型发布的推特帖子浏览量就已经超过 30 万,转发 300+次,并迅速冲到了 Hugging Face 首页。

而且用更低的成本训练出更好的模型,这也是业界诸多大模型公司一直在致力于做的事情。随着 Aksh Garg 的官宣,众多大模型爱好者蜂拥而至,探索这个最新开源的大模型的风采。

万万没想到的是,在体验与深挖技术实现的过程中,意外出现了。一位名为 pzx163 用户跑到了中国面壁智能 GitHub 项目 issue 地址下(https://github.com/OpenBMB/MiniCPM-V/issues/196),对着 MiniCPM-Llama3-V 2.5 项目作者举报:你们被“偷家”了。

斯坦福AI抄袭被实锤

Llama 3-V 似乎,有点,好像是套壳了清华系开源大模型 MiniCPM-Llama3-V 2.5。

据悉,MiniCPM-Llama3-V 2.5 是由清华系 AI 公司面壁智能推出并开源的 MiniCPM 系列最新的端侧多模态模型,总参数量为 8B,支持 30+ 种语言,多模态综合性能超越 GPT-4V-1106、Gemini Pro、Claude 3、Qwen-VL-Max 等商用闭源模型,OCR 能力及指令跟随能力得到进一步提升,可精准识别难图、长图、长文本。

面对网友们的质疑,斯坦福这支 AI 团队也坐不住了,他们表示只是使用了 MiniCPM-Llama3-V 2.5 的 tokenizer,并且宣称在 MiniCPM-Llama3-V 2.5 发布前就开始了这项工作。

但他们的解释再次遭到了质疑。

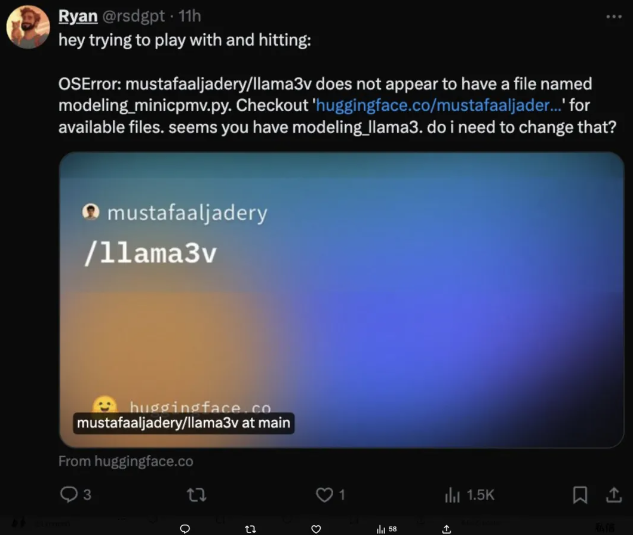

通常情况下,一款模型及其详细的 tokenizer 往往是在其发布后才能被外人知晓,那么斯坦福这支 AI 团队如何能在 MiniCPM-Llama3-V 2.5 发布之前就获取到这些信息?

这件事持续在网上发酵。但根据好事网友的复盘、梳理,Llama3V 并非只是简单的借鉴,而是有 4 点证据能充分表明其「套壳」了 MiniCPM-Llama3-V 2.5。

证据一:模型结构和代码几乎是双胞胎兄弟。

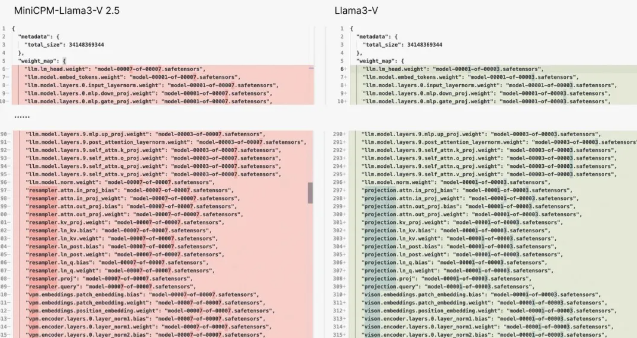

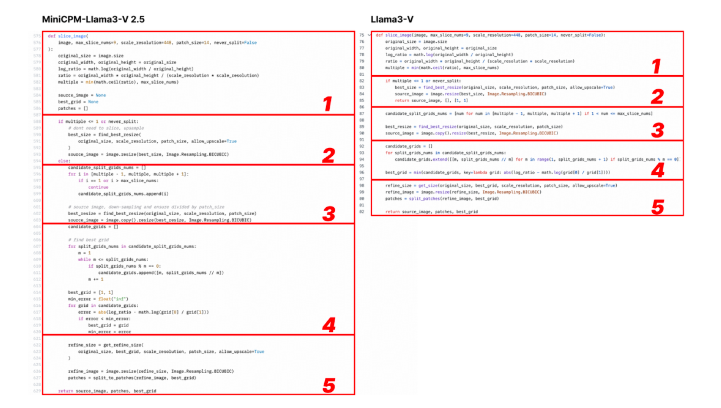

比如,套壳的 Llama3-V 与 MiniCPM-Llama3-V 2.5 几乎“共用”了完全相同的模型结构和代码。Llama3-V 的模型结构和配置文件与 MiniCPM-Llama3-V 2.5 完全相同,只是变量名不同。

证据二:Llama3-V 的代码似乎就是 MiniCPM-Llama3-V 2.5 的代码。更令人震惊的是,Llama3-V 仅仅只是进行了一些重新格式化并把一些变量重新做了命名,比如图像切片、分词器、重采样器、数据加载等变量,下图是一些示例。

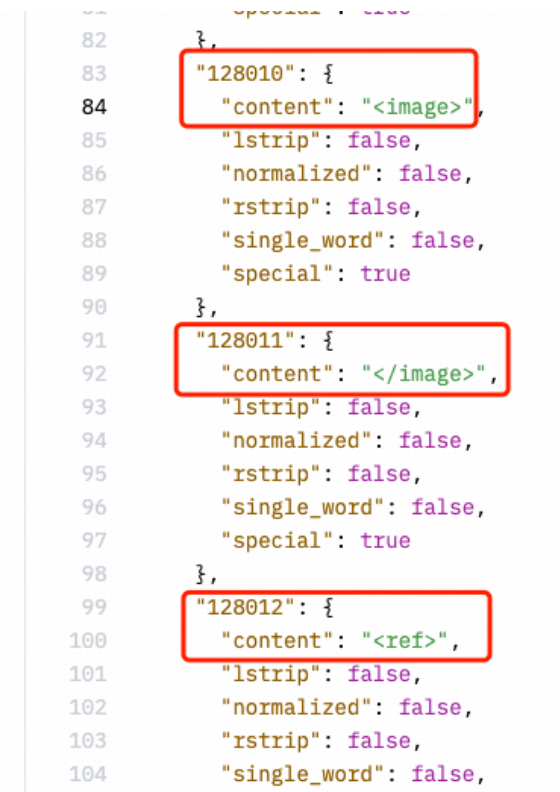

证据三:Llama3-V 的作者表示他们“引用了 LLaVA-UHD 作为架构”,还列出了差异点(关于 ViT 和 LLM 的选择)。但是他们并没有提到,这个项目的具体实现与 MiniCPM-Llama3-V 2.5 极其相似,却在空间模式等许多方面与 LLaVA-UHD 有非常多的差异。Llama3-V 也具有与 MiniCPM-Llama3V 2.5 相同的分词器,包括 MiniCPM-Llama3-V 2.5 新定义的特殊符号。

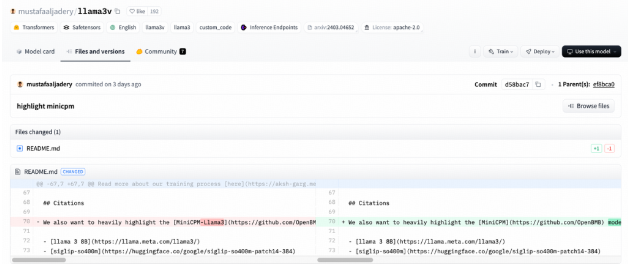

证据四:最初 Llama3-V 的作者在上传代码时直接导入了 MiniCPM-V 的代码,然后将名称更改为 Llama3-V。

https://huggingface.co/mustafaaljadery/llama3v/commit/3bee89259ecac051d5c3e58ab619e3fafef20ea6

紧急删库跑路

面对层层实锤的证据,Llama3-V 的 HuggingFace 页面现已被移除,GitHub repo 也做了删除:

Llama3-V 作者之一的 Aksh Garg 在 Medium 平台的官宣文中上更新道:

非常感谢在评论中指出与之前研究相似之处的人。我们意识到我们的架构与 OpenBMB 的“MiniCPM-Llama3-V 2.5:手机上的 GPT-4V 级多模态 LLM”非常相似,他们在实现方面领先于我们。为了尊重作者,我们删除了原始模型。

原始作者存储库的链接可以在这里找到:https://github.com/OpenBMB/MiniCPM-V/tree/main?tab=readme-ov-file

— Aksh Garg、Sid Sharma

不过关于 Llama3-V 的概述、模型架构、如何训练的细节仍然做了保留(https://aksh-garg.medium.com/llama-3v-building-an-open-source-gpt-4v-competitor-in-under-500-7dd8f1f6c9ee)。

更让人有些无奈的是,今天中午,有不少网友发现作者之一的 Aksh Garg 发布了一则道歉声明,然而没过多久,却删了,只留下上述在 Medium 平台上一句简短的回应。

对于这一事件,MinicPM-Llama3-V2.5 团队在 GitHub 上表示,「鉴于这些结果,我们很难用巧合来解释这种不寻常的相似性。我们希望作者能够对这个问题给出官方解释。我们相信这对开源社区的共同利益很重要。」

川公网安备 123456789号

川公网安备 123456789号