0延迟演示全网沸腾,秒杀GPT-4o,Moshi要成为AI圈顶流?

尽管业界翘首以盼的GPT-4o尚未正式对外开放,但法国的一支8人精英团队已悄然崛起,他们打造的Moshi原生多模态AI模型,在性能上几乎与GPT-4o并驾齐驱,现场演示更是实现了近乎零延迟的惊人效果,一时间在AI圈内引发了热烈讨论与转发狂潮。

Moshi是一款多模态大模型,具备听、说能力,未来可能展示看的能力。Kyutai实验室发布Moshi是对AI技术的大胆尝试,展现了开源精神。用户体验方面,响应速度快,语言支持有待提高,使用便捷。Moshi的拟人化语气让对话更自然流畅,未来的迭代优化将提升回答准确度。对教育行业将产生深远影响,为学生提供循环讲解。期待更多类似产品出现,支持更多地方语言,让AI技术贴近人们生活。

Moshi还处在实验原型阶段,设计初衷是为了理解和表达情感,能够支持听、说、看,可以用70种不同情绪和风格说话,甚至随时打断。

它最为突出的一个能力是,能够同时处理两个音频流,即「听」和「说」是同时进行的。

这种实时互动的实现,是基于文本和音频混合的联合预训练,用Helium中合成的文本数据,训出的70亿参数的模型。

Moshi可以实现最低160ms端到端延迟。

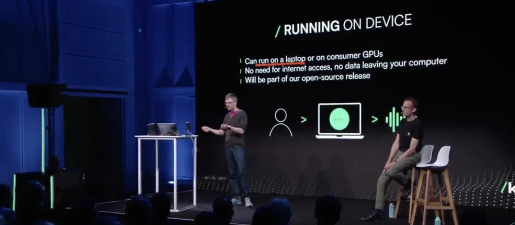

而且,最小版本的Moshi还可以在笔记本电脑,或者消费级GPU上可跑。

许多人都说这是最接近GPT-4o的模型,Moshi各种炸裂演得到了LeCun、Karpathy等AI大佬的转发。

Pytorch之父称赞道,太令人惊叹了,Kyutai实验室在实时语音助手领域处于领先地位,作为真正的非营利性开放科学组织,它将在稍后发布代码。

而现在,想要体验的小伙伴们,现在可以直接加入候补名单体验了,每次对话限时5分钟。

传送门:https://moshi.chat/?queue_id=talktomoshi

@版权声明:部分内容从网络收集整理,如有侵权,请联系删除!

川公网安备 123456789号

川公网安备 123456789号